🟦 Непрерывные случайные величины#

Непрерывная случайная величина — это случайная величина \(X\), распределение которой может быть описано функцией распределения, являющейся непрерывной функцией на \(\mathbb{R}\), а вероятность того, что \(X\) примет конкретное значение, равна нулю:

Случайная величина называется непрерывной, если существует неотрицательная функция \(f(x)\) (плотность распределения), такая что:

🔹Функция распределения (CDF)#

Функция распределения — это функция \( F_X(x) = P(X < x), \) которая определяет вероятность того, что случайная величина \(X\) примет значение, не превосходящее \(x\).

Свойства:

\(F_X(x)\) неубывающая, т.е. \( x_1 < x_2 \quad \Rightarrow \quad F_X(x_1) \leq F_X(x_2). \)

\(\displaystyle \lim_{x \to -\infty} F_X(x) = 0\), \(\displaystyle \lim_{x \to +\infty} F_X(x) = 1\).

Функция \(F_X(x)\) непрерывна на всей \(\mathbb{R}\) для непрерывной случайной величины.

Вероятность попасть в интервал выражается как:

\[ P(a < X < b) = F_X(b) - F_X(a). \]

Пусть есть некоторая функция \(\varphi(u)\,\) - монотонная функция, тогда:

🔹Плотность распределения (PDF)#

Плотность распределения — это неотрицательная функция \(f_X(x)\), связанная с функцией распределения \(F_X(x)\) соотношением:

Если \(X\) имеет плотность \(f_X(x)\), то вероятность попасть в интервал \((a, b)\) равна:

Свойства:

\(f_X(x) \geq 0\) для всех \(x\).

\(\displaystyle \int_{-\infty}^{+\infty} f_X(x)\,dx = 1\).

Плотность может быть больше 1, но интеграл по всей прямой всегда равен 1.

\(P(X = x) = 0\) для любого \(x\).

Если \(f_X\) дифференцируема, то \(F_X'(x) = f_X(x)\).

📎 Замечание:

Функция распределения описывает накопленную вероятность,

Плотность — локальную “интенсивность” вероятности.

Для непрерывных случайных величин вероятность попасть в точку равна нулю, важны только интервалы.

🔹Преобразование случайной величины через монотонную функцию#

Пусть есть случайная величина \(X\) с плотностью \(f_X(x)\) и монотонная функция \(g\).

Рассмотрим новую случайную величину:

Тогда:

Если функция \(g\) строго монотонна и дифференцируема, то

📎 Это и есть стандартное правило преобразования плотности при монотонном преобразовании.

Пример: нормальное распределение Пусть \( X \sim \mathcal{N}(a, \sigma^2). \) Её плотность выписывается как \( f_X(x) = \frac{1}{\sqrt{2\pi\sigma^2}} \exp\left\{-\frac{(x - a)^2}{2\sigma^2}\right\}, \quad x \in \mathbb{R}. \)

Введём стандартную нормированную случайную величину: \( \phi = \frac{X - a}{\sigma} \sim \mathcal{N}(0, 1). \)

Обратное преобразование: \( X = \sigma \phi + a. \) Тогда:

📎 Здесь \(g(\phi) = \sigma \phi + a\), а \(g^{-1}(x) = \frac{x - a}{\sigma}\).

📎 Замечание: этот приём широко используется для перехода от стандартного нормального распределения к произвольному \(\mathcal{N}(a,\sigma^2)\).

🔹Математическое ожидание непрерывной случайной величины#

Пусть \(X\) — непрерывная случайная величина с плотностью \(f_X(x)\).

Тогда математическое ожидание определяется формулой:

Свойства:

Математическое ожидание может быть отрицательным, нулевым или положительным.

Если плотность симметрична относительно точки \(a\), то \(\mathbb{E}[X] = a\).

Если интеграл расходится, то математическое ожидание не существует.

Пусть \(g(x)\) — измеримая функция. Тогда математическое ожидание функции от случайной величины:

📎 Замечания:

Частный случай: при \(g(x) = x\) получаем обычное математическое ожидание \(\mathbb{E}[X]\).

Если \(g(x)\) — полином, тригонометрическая функция и т.д., формула остаётся той же.

Используется, например, для нахождения \(\mathbb{E}[X^2]\), \(\mathbb{E}[e^X]\), \(\mathbb{E}[\sin X]\) и т.п.

🔹Дисперсия непрерывной случайной величины#

Дисперсия случайной величины \(X\) — это мера разброса значений \(X\) относительно её математического ожидания: \( \mathrm{Var}(X) = \mathbb{E}\big[X - \mathbb{E}[X]\big]^2. \)

Для непрерывной случайной величины с плотностью \(f_X(x)\):

📎 Часто удобнее использовать: \( \mathrm{Var}(X) = \mathbb{E}[X^2] - (\mathbb{E}[X])^2, \) где

Если \(Y = g(X)\), то:

📎 Часто используется для нахождения дисперсии после преобразований переменной — например, при линейной или квадратичной функции \(g(x)\).

🔹Основные абсолютно непрерывные распределения#

№ |

Распределение |

Обозначение |

Плотность \(f_X(x)\) |

Функция распределения \(F_X(x)\) |

\(\mathbb{E}[X]\) |

\(\mathrm{Var}(X)\) |

Когда возникает 📎 |

|---|---|---|---|---|---|---|---|

1 |

Равномерное |

\(X \sim U(a, b)\) |

\(\displaystyle f_X(x) = \begin{cases}\frac{1}{b - a}, & a \leq x \leq b \\ 0, & \text{иначе}\end{cases}\) |

\(\displaystyle F_X(x) = \begin{cases} 0,& x<a \\ \frac{x - a}{b - a},& a \leq x \leq b \\ 1,& x>b \end{cases}\) |

\(\displaystyle \frac{a + b}{2}\) |

\(\displaystyle \frac{(b - a)^2}{12}\) |

Все значения в интервале равновероятны. Например: измерение времени в равномерном окне. |

2 |

Экспоненциальное |

\(X \sim \mathrm{Exp}(\lambda)\) |

\(\displaystyle f_X(x) = \begin{cases}\lambda e^{-\lambda x}, & x \geq 0 \\ 0, & x < 0\end{cases}\) |

\(\displaystyle F_X(x) = 1 - e^{-\lambda x}, \quad x \geq 0\) |

\(\displaystyle \frac{1}{\lambda}\) |

\(\displaystyle \frac{1}{\lambda^2}\) |

Время до первого события в потоке Пуассона. Например: время до прихода клиента. |

3 |

Нормальное (гауссово) |

\(X \sim \mathcal{N}(\mu, \sigma^2)\) |

\(\displaystyle f_X(x) = \frac{1}{\sigma \sqrt{2\pi}} e^{-\frac{(x - \mu)^2}{2\sigma^2}}\) |

\(\displaystyle F_X(x) = \Phi\left(\frac{x - \mu}{\sigma}\right)\) (через стандартную \(\Phi\)) |

\(\mu\) |

\(\sigma^2\) |

Очень часто встречается в природе: сумма большого числа малых независимых факторов. |

4 |

Стандартное нормальное |

\(X \sim \mathcal{N}(0, 1)\) |

\(\displaystyle f_X(x) = \frac{1}{\sqrt{2\pi}} e^{-\frac{x^2}{2}}\) |

\(\displaystyle F_X(x) = \Phi(x)\) (нет аналитической формы) |

\(0\) |

\(1\) |

Базовое распределение, часто используется для стандартизации. |

5 |

Гамма |

\(X \sim \mathrm{Gamma}(k,\lambda)\) |

\(\displaystyle f_X(x) = \frac{\lambda^k x^{k - 1} e^{-\lambda x}}{\Gamma(k)}, \quad x \geq 0\) |

через неполную гамма-функцию |

\(\displaystyle \frac{k}{\lambda}\) |

\(\displaystyle \frac{k}{\lambda^2}\) |

Сумма \(k\) независимых экспоненциальных величин. |

6 |

\(\chi^2\) (хи-квадрат) |

\(X \sim \chi^2(k)\) |

\(\displaystyle f_X(x) = \frac{1}{2^{k/2}\Gamma(k/2)} x^{\frac{k}{2}-1} e^{-x/2},\ x\ge 0\) |

через неполную гамма-функцию |

\(k\) |

\(2k\) |

Квадрат нормы стандартного нормального вектора. Часто в статистике. |

7 |

Бета |

\(X \sim \mathrm{Beta}(\alpha,\beta)\) |

\(\displaystyle f_X(x) = \frac{1}{B(\alpha,\beta)} x^{\alpha - 1} (1 - x)^{\beta - 1},\ 0<x<1\) |

через неполную бета-функцию |

\(\displaystyle \frac{\alpha}{\alpha+\beta}\) |

\(\displaystyle \frac{\alpha\beta}{(\alpha+\beta)^2(\alpha+\beta+1)}\) |

Ситуация: задаётся на отрезке \([0, 1]\) и гибко моделирует разные формы распределений в зависимости от параметров \(\alpha\) и \(\beta\). Моделирование долей и вероятностей (например, доля успешных исходов) |

8 |

Коши |

\(X \sim \mathrm{Cauchy}(x_0, \gamma)\) |

\(\displaystyle f_X(x) = \frac{1}{\pi \gamma} \frac{\gamma^2}{(x - x_0)^2 + \gamma^2}\) |

\(\displaystyle F_X(x) = \frac{1}{\pi} \arctan\left(\frac{x - x_0}{\gamma}\right)+\frac12\) |

не существует |

не существует |

это распределение описывает случайные величины с «тяжёлыми хвостами». Оно часто появляется в задачах, связанных с отношением двух нормальных случайных величин (например, при оценке отношения сигнал/шум). Пример: измерение угла отклонения в эксперименте, ошибки навигации, |

9 |

Логнормальное |

\(X \sim \mathrm{LogNormal}(\mu,\sigma^2)\) |

\(\displaystyle f_X(x) = \frac{1}{x\sigma\sqrt{2\pi}} e^{-\frac{(\ln x - \mu)^2}{2\sigma^2}},\ x>0\) |

\(\displaystyle F_X(x) = \Phi\left(\frac{\ln x - \mu}{\sigma}\right)\) |

\(\displaystyle e^{\mu + \frac{\sigma^2}{2}}\) |

\(\displaystyle (e^{\sigma^2}-1)e^{2\mu+\sigma^2}\) |

Величина распределена логнормально, если её логарифм имеет нормальное распределение. |

10 |

Парето |

\(X \sim \mathrm{Pareto}(x_m,\alpha)\) |

\(\displaystyle f_X(x) = \frac{\alpha x_m^\alpha}{x^{\alpha+1}},\ x \ge x_m\) |

\(\displaystyle F_X(x) = 1 - \left(\frac{x_m}{x}\right)^\alpha\) |

\(\displaystyle \frac{\alpha x_m}{\alpha - 1}\) (если \(\alpha>1\)) |

\(\displaystyle \frac{\alpha x_m^2}{(\alpha - 1)^2(\alpha - 2)}\) (если \(\alpha>2\)) |

Описывает явления, где «немногие дают львиную долю результата».Имеет длинный хвост и часто используется для моделирования неравномерных распределений ресурсов. |

📎 Пояснения к параметрам:

\(\lambda\) — интенсивность потока,

\(\mu, \sigma\) — среднее и стандартное отклонение,

\(k\) — параметр формы,

\(\alpha, \beta\) — параметры формы бета- и парето-распределений,

\(x_m\) — минимальное значение,

\(\gamma\) — параметр масштаба, \(x_0\) — сдвиг.

📎 Замечания:

Равномерное — базовое равномерное распределение

Экспоненциальное и гамма — для времени ожидания событий

Нормальное — классика статистики

Бета — удобно для вероятностей на [0,1]

Коши — пример распределения без ожидания и дисперсии

Логнормальное и Парето — часто в экономике и моделировании редких крупных событий

🟦 Двумерные случайные величины#

Пусть \(X\) и \(Y\) — две случайные величины, определённые на одном вероятностном пространстве.

Тогда двумерной случайной величиной называется вектор \((X, Y).\)

📎 Иными словами, мы рассматриваем пару случайных величин как одну случайную величину, принимающую значения в \(\mathbb{R}^2\).

🔹Двумерная функция распределения#

Двумерной функцией распределения случайного вектора \((X, Y)\) называется функция \( F_{X,Y}(x, y) = P(X < x, Y < y), \) которая полностью описывает распределение пары случайных величин.

Если случайная величина \((X, Y)\) имеет двумерную плотность распределения \(f_{X,Y}(x, y)\), то

📎 Эта формула аналогична одномерной, но с двойным интегралом.

Свойства функции распределения

\(0 \leq F_{X,Y}(x, y) \leq 1\)

Невозрастающая по \(x\) и по \(y\)

\( \lim_{x \to -\infty \text{ или } y \to -\infty} F_{X,Y}(x, y) = 0, \)

\( \lim_{x \to +\infty,\, y \to +\infty} F_{X,Y}(x, y) = 1.\)

Плотность \(f_{X,Y}(x,y)\) неотрицательна и интегрируется в 1 по всей плоскости \(\mathbb{R}^2\): \( \iint\limits_{\mathbb{R}^2} f_{X,Y}(x, y)\, dx\, dy = 1.\)

Непрерывна слева по каждому аргументу.

🔹Двумерная плотность распределения#

Если \(F_{X,Y}(x, y)\) непрерывна и дифференцируема, то двумерная плотность распределения определяется как

Свойства плотности

\(f_{X,Y}(x, y) \geq 0\) для всех \((x, y)\).

\( \iint_{\mathbb{R}^2} f_{X,Y}(x, y) \, dx\, dy = 1. \)

Функция распределения восстанавливается через плотность двойным интегралом.

Маргинальные плотности находятся интегрированием по другой переменной:

Если \(X\) и \(Y\) независимы, то \( f_{X,Y}(x, y) = f_X(x)\, f_Y(y), \) \( F_{X,Y}(x, y) = F_X(x)\, F_Y(y). \)

🔹Математическое ожидание и дисперсия двумерной случайной величины#

Пусть \((X, Y)\) — абсолютно непрерывная двумерная случайная величина с плотностью \(f_{X,Y}(x, y)\). Тогда

Аналогично для функций:

Дисперсии:

📎 При необходимости можно также определить ковариацию:

🔹Формула свёртки#

Пусть \(X\) и \(Y\) — независимые абсолютно непрерывные случайные величины с плотностями \(f_X(x)\) и \(f_Y(x)\).

Рассмотрим

Тогда плотность распределения \(Z\) определяется формулой свёртки:

📎 Это означает, что распределение суммы двух независимых случайных величин находится свёрткой их плотностей.

📎Эта формула работает в случае, если плотность хотябы одного аргумена задана на интервале \((-\infty, +\infty)\).

📎Если обе плотности \(f_X\) и \(f_Y\) заданы на конечных интервалах, то для отыскивания \(f_Z\) величины \(Z = X + Y\) целесобразно сначала найти функцию распределения \(F_Z(u)\), а затем продиффиринцировать ее по u: \(f_Z(u) = F'_Z(u)\).

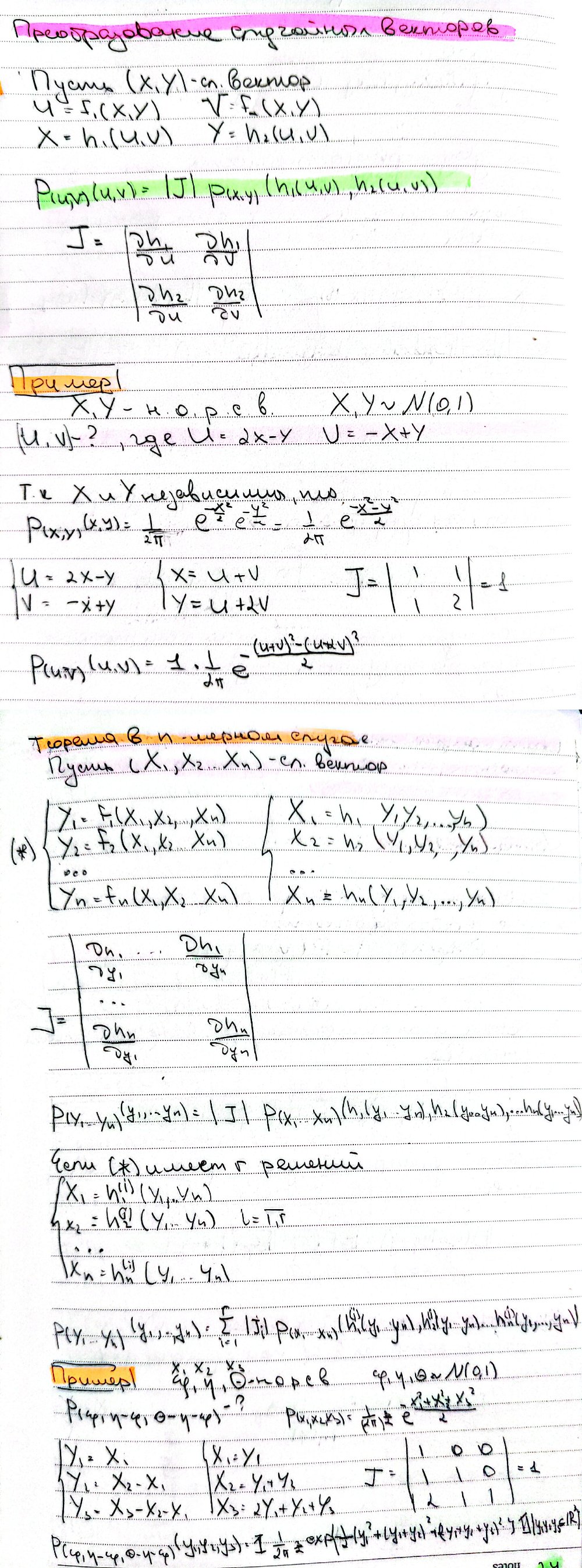

🔹Преобразование случайных векторов#

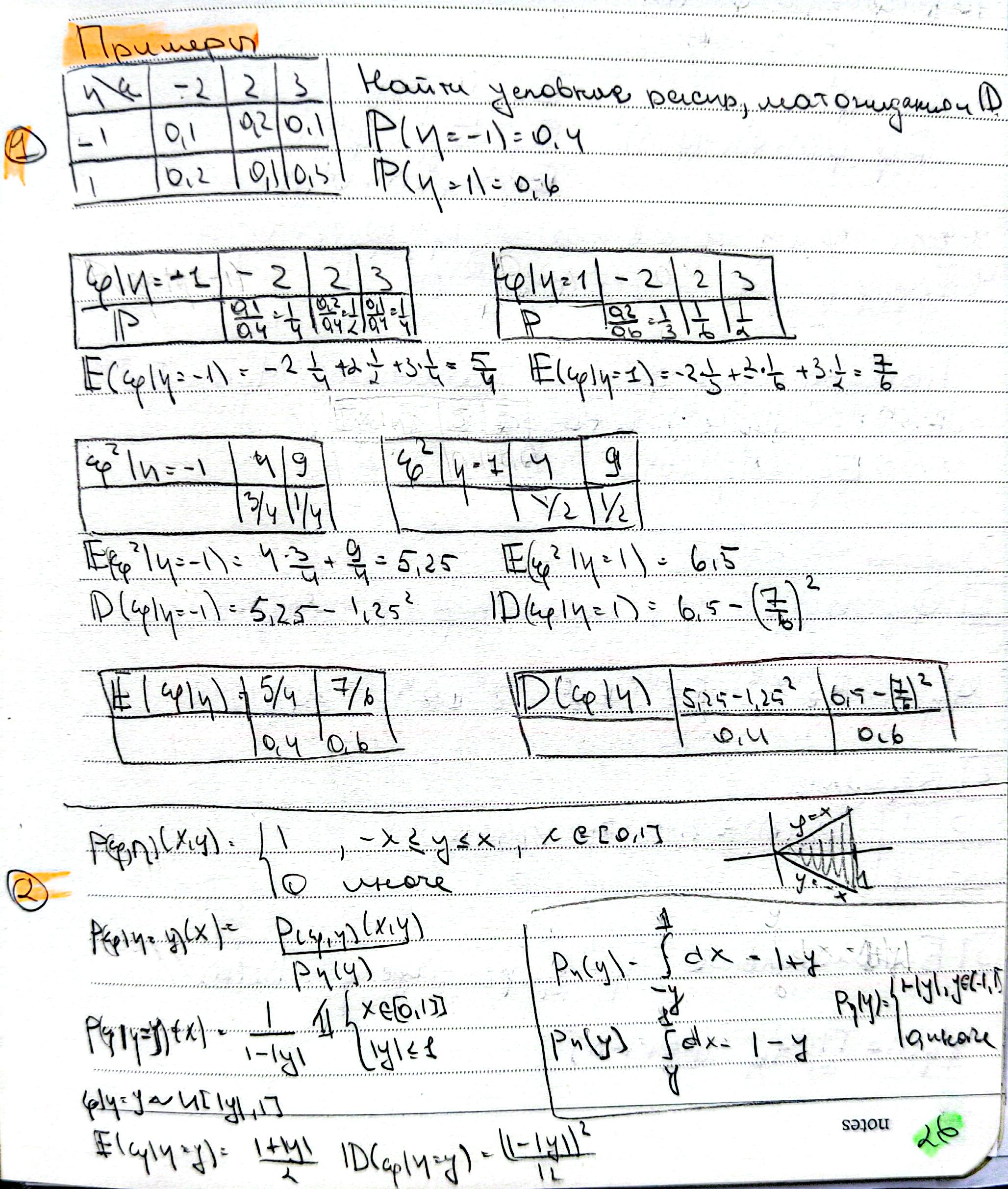

🔹Условные законы распределения#

📎 Это условные плотности случайных величин при фиксированном значении второй.

🔹Условные математические ожидания#

в дискретном случае:

📎 Эти формулы используются, например, при работе с зависимыми случайными величинами.

Свойства Пусть \((X, Y)\) — случайные величины, для которых определено условное математическое ожидание \(\mathbb{E}[X \mid Y]\).

Линейность: \( \mathbb{E}[aX + bZ \mid Y] = a\,\mathbb{E}[X \mid Y] + b\,\mathbb{E}[Z \mid Y],\) где \(a,b\) — константы.

Если \(X\) не зависит от \(Y\), то \( \mathbb{E}[X \mid Y] = \mathbb{E}[X]. \)

Если \(X\) — функция от \(Y\), то \( \mathbb{E}[X \mid Y] = X. \)

Закон повторного (полного) ожидания \( \mathbb{E}[\mathbb{E}[X \mid Y]] = \mathbb{E}[X]. \)

Если \(g(Y)\) — измеримая функция от \(Y\), то \( \mathbb{E}[g(Y)\,X \mid Y] = g(Y)\,\mathbb{E}[X \mid Y].\)

🔹Связь между совместным и условным распределениями#

📎 Если \(X\) и \(Y\) независимы, то\( f_{X,Y}(x,y) = f_X(x) \, f_Y(y), \)

и условные плотности совпадают с безусловными.

🔹Условная дисперсия#

Условная дисперсия случайной величины \(X\) при \(Y = y\) определяется как

\( \mathrm{Var}(X \mid Y = y) = \mathbb{E}\bigl[(X - \mathbb{E}[X \mid Y = y])^2 \mid Y = y\bigr]. \)

А условная дисперсия как случайная величина:

\( \mathrm{Var}(X \mid Y) = \mathbb{E}\bigl[(X - \mathbb{E}[X \mid Y])^2 \mid Y\bigr]. \)

В эквивалентной форме:

\( \mathrm{Var}(X \mid Y) = \mathbb{E}[X^2 \mid Y] - \bigl(\mathbb{E}[X \mid Y]\bigr)^2. \)

Закон полной дисперсии Существует разложение общей дисперсии:

\( \mathrm{Var}(X) = \mathbb{E}[\mathrm{Var}(X \mid Y)] + \mathrm{Var}(\mathbb{E}[X \mid Y]). \)

Здесь

\(\mathbb{E}[\mathrm{Var}(X \mid Y)]\) — средняя условная дисперсия,

\(\mathrm{Var}(\mathbb{E}[X \mid Y])\) — дисперсия условного математического ожидания.

Это соотношение удобно для вычислений и часто используется в теории вероятностей и статистике.

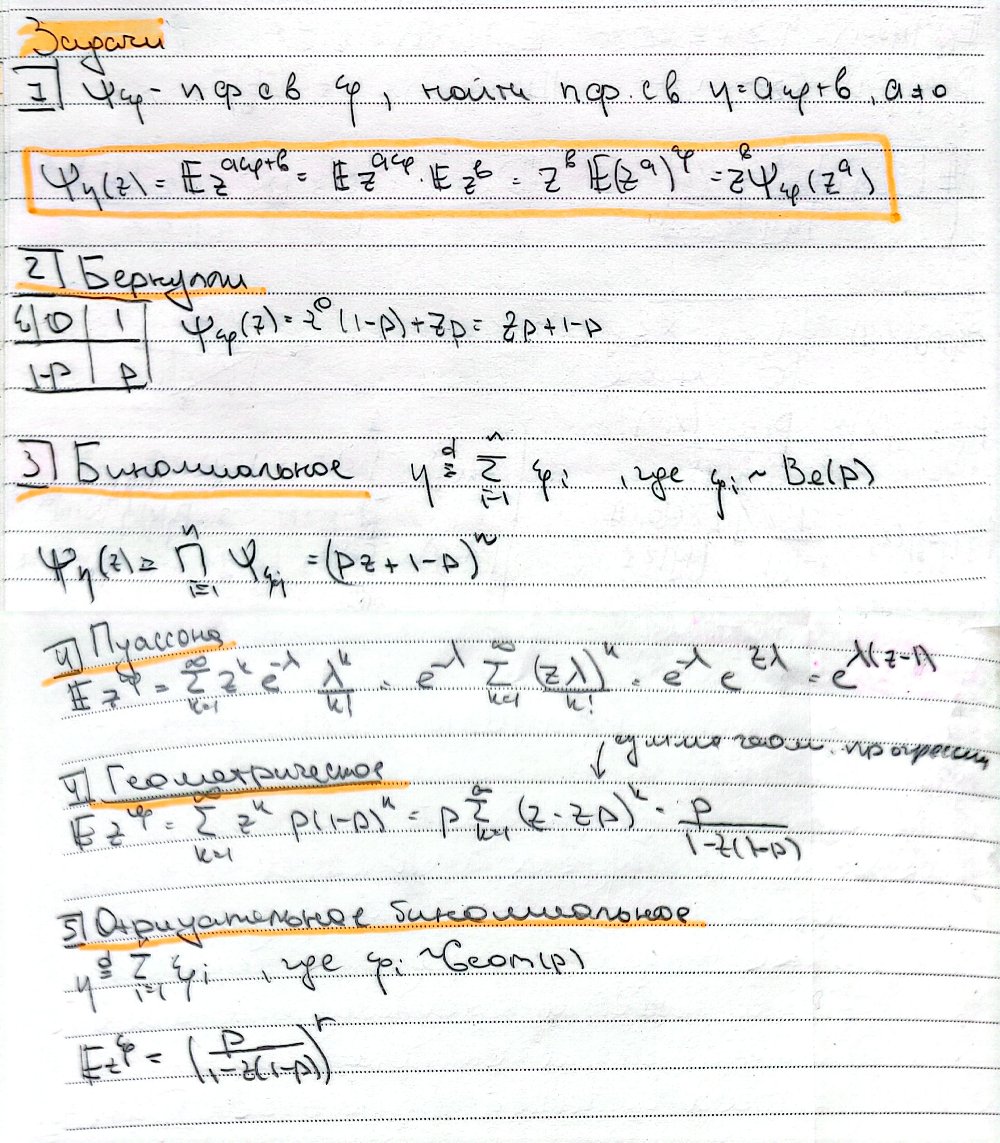

Задачи:

🔹Производящая функция вероятностей и ее свойства#

Пусть \(X\) — дискретная случайная величина, принимающая неотрицательные целые значения \(0, 1, 2, \dots\)

с вероятностями \(p_k = P\{X = k\}\).

Производящая функция вероятностей (или ПФВ) определяется как

где \(z\) — комплексное число.

Эта функция полностью определяет закон распределения дискретной случайной величины.

Основные свойства

Связь с вероятностями \( p_k = \frac{\psi_{X}^{(k)}(0)}{k!}, \) где \(\psi_{X}^{(k)}(0)\) — \(k\)-я производная производящей функции в точке \(z = 0\).

Значение в \(z=1\): \( \psi_{X}(1) = \sum_{k=0}^{\infty} p_k = 1. \)

Математическое ожиданиe: \( \mathbb{E}[X] = \psi_{X}'(1). \) Дисперсия: \( \mathrm{Var}(X) = \psi_{X}''(1) + \psi_{X}'(1) - \bigl(\psi_{X}'(1)\bigr)^2. \)

Если \(X\) и \(Y\) независимы, то для \(Z = X + Y\): \( \psi_{Z}(z) = \psi_{X}(z)\, \psi_{Y}(z). \)

Для \(n\) одинаково распределённых независимых величин \( \psi_{S_n}(z) = \bigl(\psi_{X}(z)\bigr)^n, \) где \(S_n = X_1 + X_2 + \cdots + X_n\).

Для детерминированной случайной величины \( P\{X = k_0\} = 1 \quad \Rightarrow \quad \psi_{X}(z) = z^{k_0}. \)

Если производная существует, то \(r\)-й факториальный момент: \( \mathbb{E}[X(X - 1)\cdots(X - r + 1)] = \psi_{X}^{(r)}(1).\)

Примечание. Производящая функция вероятностей особенно удобна для:

анализа распределений с поддержкой на \(\mathbb{N}_0\);

нахождения распределения суммы независимых случайных величин;

вычисления моментов;

работы с распределениями типа Пуассона, биномиального и геометрического.

Задачи:

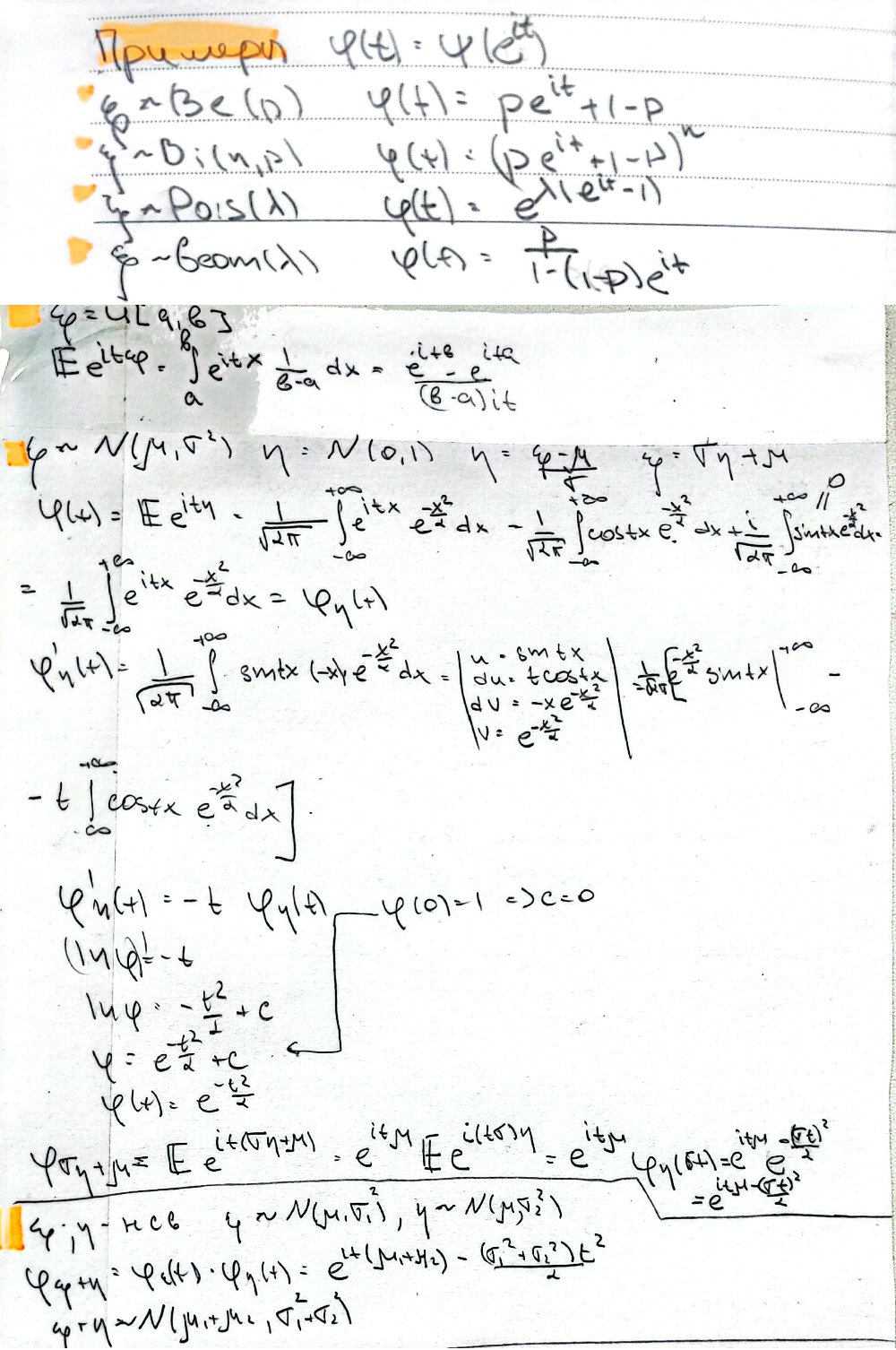

🔹Характеристическая функция#

Пусть \(X\) — случайная величина.

Характеристической функцией случайной величины \(X\) называется функция

где \(i\) — мнимая единица (\(i^2 = -1\)).

📎 Характеристическая функция существует всегда, так как \(|e^{itX}| = 1\).

Свойства

\( \varphi_{X}(0) = 1. \)

\( |\varphi_{X}(t)| \le 1 \quad \text{для всех } t \in \mathbb{R}. \)

Характеристическая функция непрерывна по \(t\).

Характеристическая функция полностью определяет распределение случайной величины.

Если \(X\) и \(Y\) независимы, то \( \varphi_{X + Y}(t) = \varphi_{X}(t)\, \varphi_{Y}(t). \)

Если \(X = c\) (константа), то \( \varphi_{X}(t) = e^{itc}. \)

Если \(\mathbb{E}[|X|] < \infty\), то \( \varphi'_{X}(0) = i\,\mathbb{E}[X]. \) Если \(\mathbb{E}[X^2] < \infty\), то \( \varphi''_{X}(0) = -\mathbb{E}[X^2]. \)

Если \(\mathbb{E}[|X|^n] < \infty\), то \( \mathbb{E}[X^n] = \frac{1}{i^n}\,\varphi_{X}^{(n)}(0). \)

Если \(Y = aX + b\), то \( \varphi_{Y}(t) = e^{itb}\,\varphi_{X}(at). \)

Если \(\varphi_{X}(t) = \varphi_{Y}(t)\) для всех \(t\), то распределения \(X\) и \(Y\) совпадают.

\( f_{X}(x) = \frac{1}{2\pi}\int_{-\infty}^{\infty} e^{-itx}\,\varphi_{X}(t)\,dt.\)

Для дискретных случайных величин \( \varphi_{X}(t) = \mathbb{E}[e^{itX}] = \sum_{k=0}^{\infty} p_k e^{itk} = \psi_{X}(e^{it}).\)

Задачи: